使用 PySpark 扩展数据

现代 PySpark 的架构

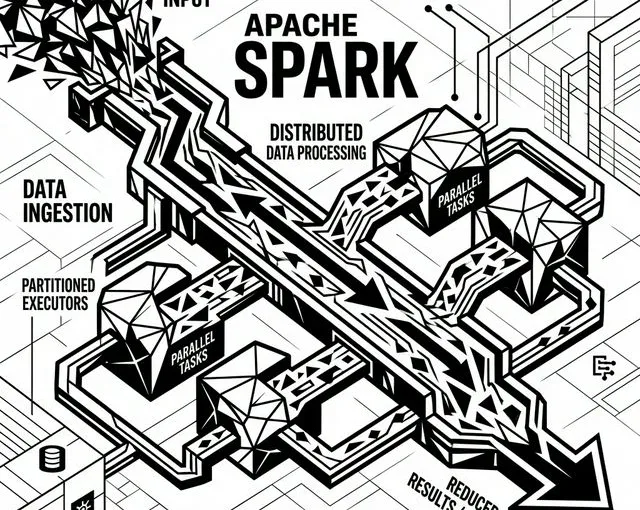

当数据机构面临高达数 TB 的分析需求时,简单的 Pandas 流程就会碰壁。这就是 PySpark 发挥作用的地方:它是 Apache Spark 的 Python 接口。

PySpark 专为集群计算框架设计,它跨服务器网络同时分配数据处理任务。通过依赖内存计算,它执行 MapReduce 算法的速度明显快于传统的基于磁盘的 Hadoop 生态系统。

核心范式

- 弹性分布式数据集 (RDD):Spark 的基本逻辑。它们是不可变的分布式数据块组合,可自动跨集群分区。

- DataFrames 和 SQL:在后来的发行版中,PySpark 集成了 DataFrames,提供了一个高度优化的方案感知系统,与查询 SQL 表完全一致。

- 延迟计算:PySpark 不会在发生最终操作(例如

.show()或.write())之前执行计算管道。这使得它可以在实际接触任何内存字节之前,全局优化整个分析树。

“一个强大的计算引擎不取决于它能否在一台大型服务器上进行大量计算,而在于它能够多高效地在数十台小型服务器之间分配并行线程。”

Demlon 积极部署基于云的 PySpark 数据通道网络,以在挖掘企业级模式时展现无与伦比的速度。如果您的管道正在阻碍关键报告的通过,那么分布式处理就是最终答案。