توسيع البيانات باستخدام PySpark

البنية المعمارية الحديثة لـ PySpark

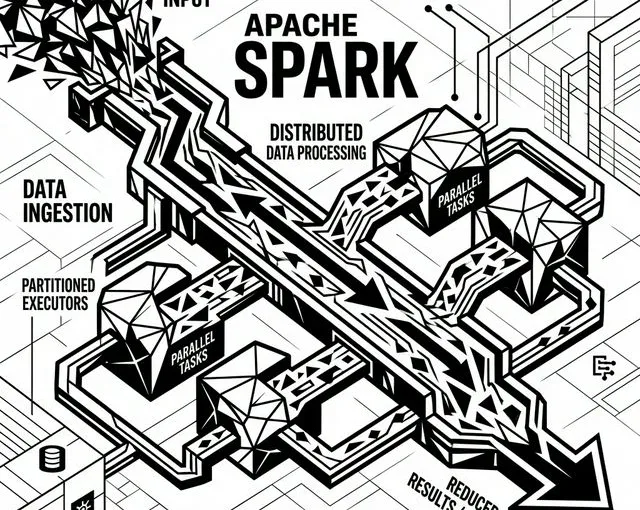

عندما تواجه وكالات البيانات تلبية متطلبات تحليلية ضخمة تصل إلى مستوى التيرابايت، فإن تبسيط معالجة Pandas يصل إلى جدار لا يمكن اختراقه. هنا يأتي دور PySpark: واجهة لغة Python الخاصة بـ Apache Spark.

تم تصميم PySpark خصيصًا حول إطار عمل حوسبة العناقيد (Cluster-computing)، فهو يوزع مهام معالجة البيانات بشكل متزامن عبر شبكة من الأجهزة. بالاعتماد على الحوسبة داخل الذاكرة (In-memory)، فإنه ينفذ خوارزميات MapReduce بشكل أسرع بكثير من بيئات Hadoop التقليدية القديمة المستندة إلى الأقراص.

النماذج الأساسية لـ PySpark

- مجموعات البيانات الموزعة المرنة (RDDs): المنطق التأسيسي لـ Spark. وهي مجموعات بيانات غير قابلة للتغيير موزعة ومقسمة تلقائياً عبر مجموعتك الرئيسية.

- إطارات البيانات (DataFrames) و SQL: في التوزيعات اللاحقة، قامت PySpark بدمج إطارات البيانات مما يوفر نظاماً مدركاً للهيكلة ومُحسناً بشكل كبير جداً يتماثل مع استعلامات جداول SQL.

- التقييم الكسول (Lazy Evaluation): لا تنفذ PySpark تسلسل الاستعلام حتى يتم تشغيل إجراء نهائي محدد (مثل

.show()أو.write()). يتيح ذلك للبرنامج تحسين خطة التنفيذ المادية بالكامل قبل استهلاك أي جزء من الذاكرة.

“لا يُحكم على المحرك القوي من خلال مقدار ما يمكنه حسابه على سيرفر ضخم، ولكن بمدى كفاءته بجدولة الخيوط المتوازية عبر عشرات الأجهزة الصغيرة.”

تقوم Demlon بنشر ونشر منطق PySpark بشكل فعال عبر شبكات EMR والشبكات الأصلية السحابية لاستخراج سرعات لا مثيل لها عند تعدين ومعالجة قواعد البيانات المعقدة على مستوى المؤسسات. إذا كانت خطوط الأنابيب الخاصة بك تعيق إنشاء التقارير التحليلية، فإن الحوسبة الموزعة هي الحل الفاصل والنهائي.